本文属于机器翻译版本。若本译文内容与英语原文存在差异,则一律以英文原文为准。

Amazon SageMaker 调试器

使用 Amazon Debugger 实时调试机器学习训练作业中的模型输出张量,并检测非融合问题。 SageMaker

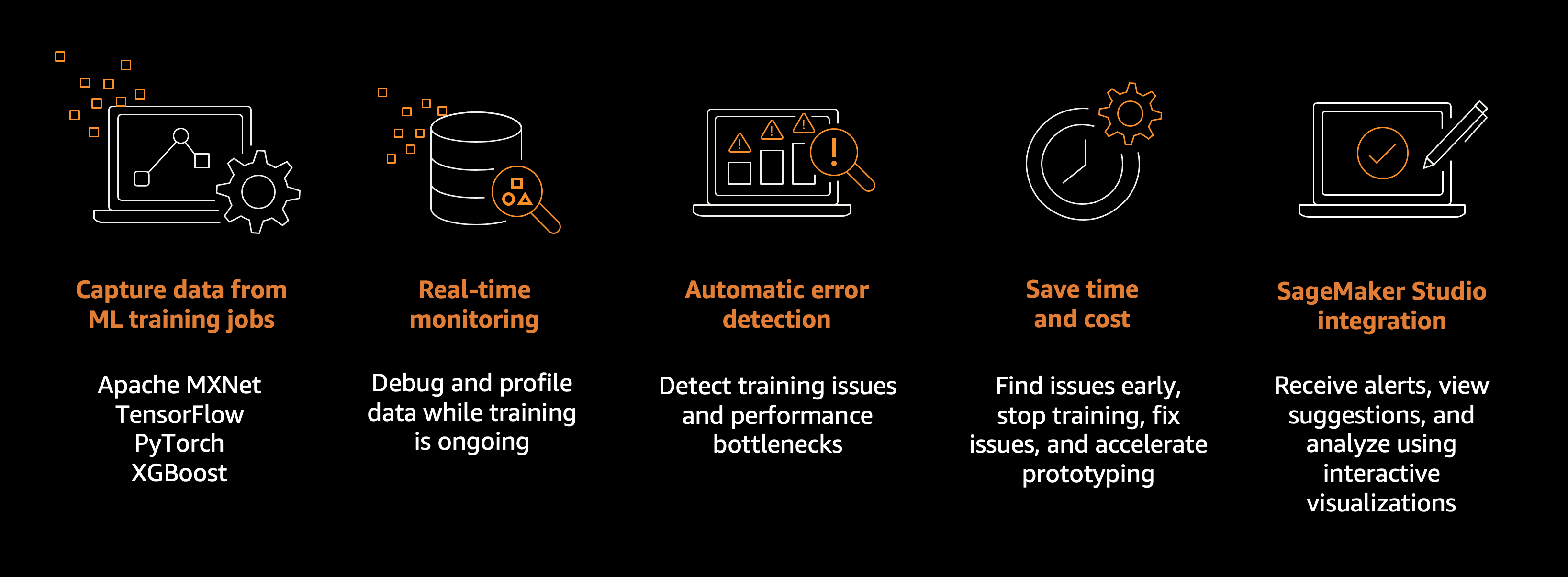

Amazon SageMaker 调试器功能

机器学习 (ML) 训练作业可能存在系统瓶颈、过度拟合、饱和激活函数和梯度消失等问题,这些问题会影响模型性能。

SageMaker Debugger 提供了用于调试训练作业和解决此类问题的工具,从而提高模型的性能。Debugger 也提供了一些工具,用于在发现训练异常情况时发送警报,针对问题采取措施,并通过将收集的指标和张量可视化来确定造成问题的根本原因。

SageMaker 调试器支持 Apache MXNet、 PyTorch TensorFlow、和框架。 XGBoost 有关 D SageMaker ebugger 支持的可用框架和版本的更多信息,请参阅支持的框架和算法。

Debugger 工作流概述如下:

-

如果需要,可以使用

sagemaker-debuggerPython SDK 修改您的训练脚本。 -

使用 SageMaker 调试器配置 SageMaker 训练作业。

-

使用 SageMaker AI 估算器 API 进行配置(适用于 Python SDK)。

-

使用 SageMaker AI

CreateTrainingJob请求进行配置(适用于 Boto3 或 CLI)。 -

使用 SageMaker 调试器配置自定义训练容器。

-

-

启动训练作业并实时监控训练问题。

-

获取警报并针对训练问题迅速采取措施。

-

使用 为规则使用 Debugger 内置操作,在发现训练问题时接收短信和电子邮件并停止训练作业。

-

-

探索对训练问题的深入分析。

-

有关调试模型输出张量的信息,请参阅在中可视化调试器输出张量 TensorBoard。

-

-

修复问题,考虑 Debugger 提供的建议,然后重复步骤 1-5,直到模型得到优化并达到目标准确性。

《 SageMaker 调试器开发者指南》将引导您完成以下主题。